Парадокс продуктивности при внедрении ИИ в бизнесе и разработке: компании платят больше, получают меньше

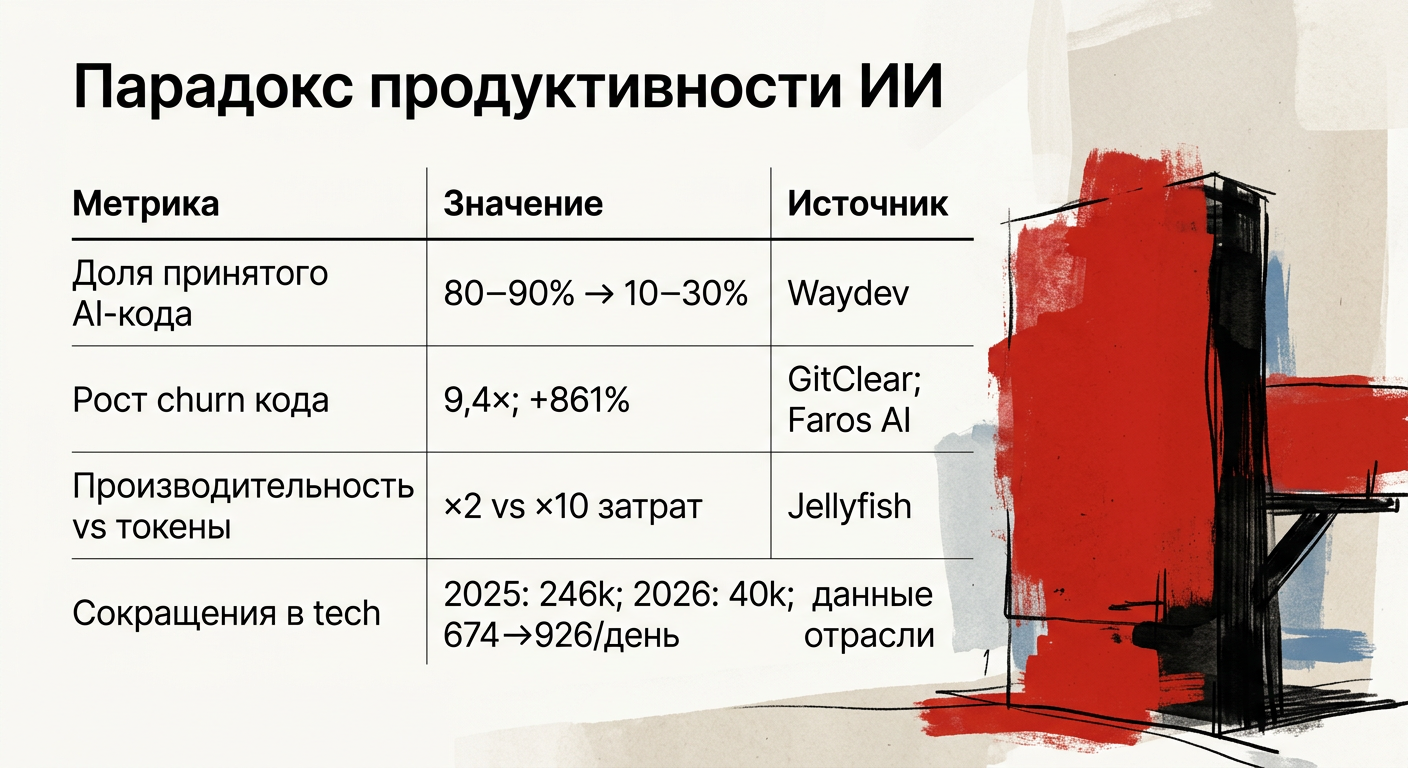

Компании вкладывают в AI‑инструменты миллионы, но устойчивого роста нет. Появляется больше кода и задач, но не результата. Например, у пользователей ИИ code churn растёт в 9,4 раза, а затраты на токены могут вырасти в 10 раз при слабом приросте пользы.

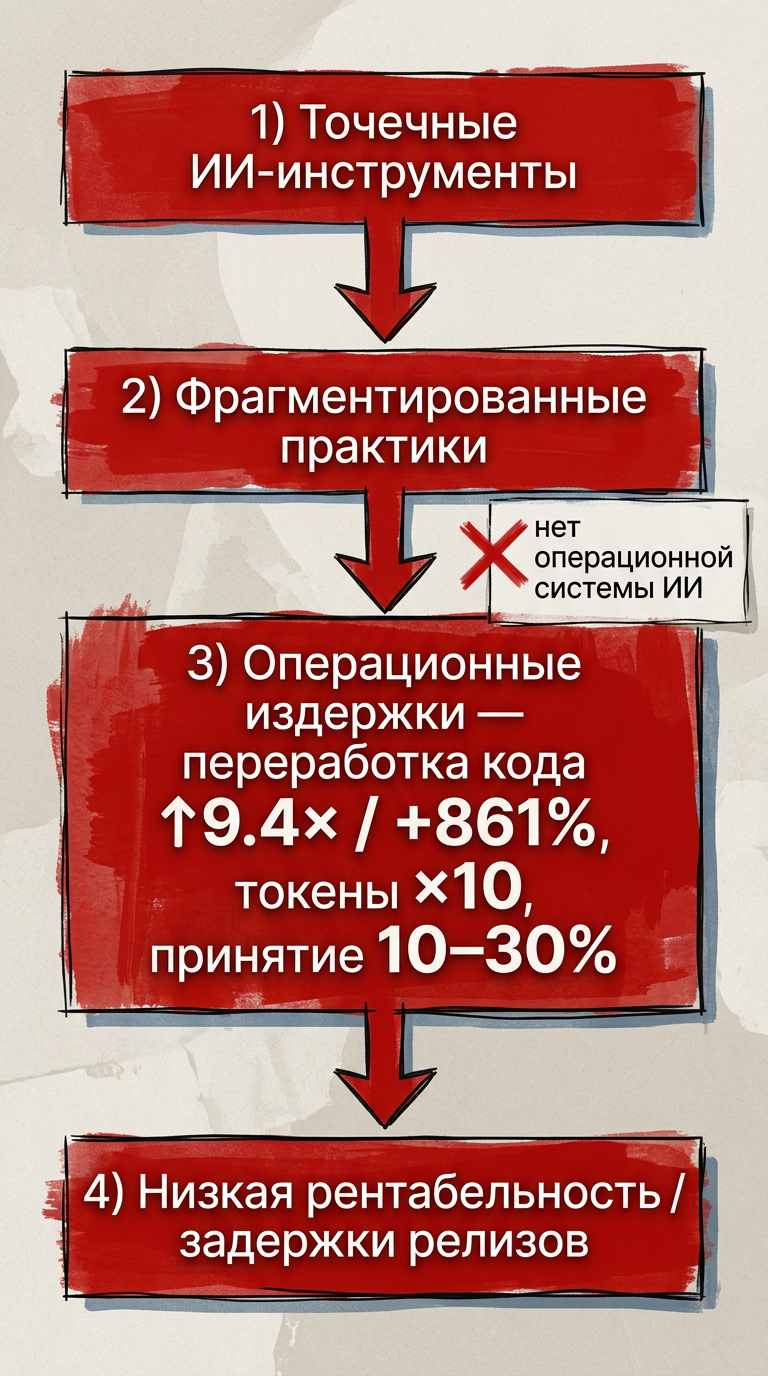

Это не про «плохие модели». Разрыв возникает, когда точечные решения не связаны общей операционной системой. Инструменты масштабируются быстрее, чем управление и правила их применения. В итоге эффект дробится иногда становится отрицательным.

Последствия заметны: планы релизов плавают, расходы на токены растут, полезная выдача почти не меняется. Этот материал для CTO и техлидов, которые уже используют Claude Code, Cursor и ждут прироста, а получают противоречивые метрики. Ниже — почему это происходит и какие элементы управления нужны до покупки следующего инструмента.

Локальная скорость против системной продуктивности

Кажется, что AI‑ассистент ускорит команду сразу. Есть снипеты, автотесты, быстрые правки. Логика простая: больше инструментов — выше скорость.

Но локальная скорость не равна системной продуктивности. Локальная — это быстрее выполнить отдельную задачу. Системная — это предсказуемо выпускать релизы с нужным качеством и затратами.

Когда инструментов много и нет общего слоя, процессы дробятся. Метрики начинают расходиться с ожиданиями. Растёт code churn (до 9,4× по GitClear и до +861% по Faros), а «ускорение» требует в 10 раз больше токенов при слабом приросте результата (Jellyfish).

Итог — непредсказуемые релизы, скачущий бюджет и ломающееся планирование. Причина не в моделях, а в управлении.

Почему локальные выигрыши дают системные издержки

Как это работает

AI внедряют на уровне задач и людей. Claude Code или Cursor дают быстрые правки, тесты, генерацию кода. В отдельных сессиях это выглядит как экономия времени.

Но между локальной скоростью итоговой продуктивностью стоит согласование процессов. Без единой модели каждый инструмент создаёт свой поток артефактов и правил. Получается набор несвязанных улучшений.

Почему возникает разрыв

Первое — скорость внедрения выше, чем скорость выстраивания стратегии. Во Вьетнаме и других регионах ИИ массово используют на уровне команд без координации. Это усиливает несогласованность.

Второе — данные инженерная дисциплина не успевают. Waydev (более 10 000 инженеров в 50 компаниях) показывает: номинально принимают 80–90% AI‑кода, но после правок остаётся 10–30%. Значит, большая часть требует доработок, которые съедают выигрыш.

Третье — растут скрытые издержки. GitClear фиксирует 9,4× рост churn, Faros — до +861%. Jellyfish видит ×2 к «скорости» при ×10 к затратам на токены. Локальная скорость покупается ценой шума и переработок.

Что нужно добавить в «операционную систему ИИ»

— Единые правила использования: где и как применять ассистентов, требования коду и тестам. — Метрики «стоимость → результат»: токены на задачу, доля принятых изменений, churn, время ревью. — Пайплайны: генерация → валидация → ревью → интеграция с автоматическими проверками. — Управление доступом к данным: единый слой знаний источников, чтобы ответы опирались на актуальные данные.

К чему это приводит

Без этих элементов ROI нестабилен, релизы сдвигаются, растёт нагрузка на сеньоров и менеджмент. Видимая скорость есть, предсказуемости нет.

Вывод

Проблема не в инструментах. Без «операционной системы ИИ» локальные ускорения превращаются в системные издержки.

Типовые сценарии с потерей эффективности

Быстрый патч превращается в долгий ревью

Сеньор правит баг через Claude Code и отправляет PR. Правок много и они «быстрые». Ревью возвращает изменения: несответствие архитектуре, падающие тесты, рост churn. У пользователей ИИ churn может расти до 9,4×. Итог — часы на исправления вместо минут на генерацию.

Протип дешевет, бюджет дорожает

Команда использует Cursor для прототипов. Результаты есть, но на второй месяц растут счета. Много итераций и дублей запросов. Jellyfish фиксирует: ×2 к скорости при ×10 к затратам на токены. Итог — деньги уходят в токены, ценность растёт медленно.

Команды ускоряются, релиз замедляется

Несколько команд внедряют разные инструменты. Код пишется быстрее, но интеграция конфликтует. Waydev показывает: после правок остаётся 10–30% принятого AI‑кода. Faros фиксирует рост churn до +861%. Итог — релиз сдвигается, усилия уходят в исправления.

Метрика | Значение | Источник / примечание |

|---|---|---|

Доля принятого AI‑кода | Номинально 80–90% → фактически 10–30% после доработок | Waydev (работа с >10 000 инженеров в 50 компаниях) |

Рост code churn | 9,4× (GitClear); +861% (Faros AI) | GitClear; Faros AI |

Производительность vs расходы на токены | Производительность ×2 при росте затрат на токены ×10 | Jellyfish |

Сокращения в tech | 2025: ~246 000 уволенных (55 000 связаны с ИИ); 2026 (первые месяцы): ~40 000; темп увольнений вырос с 674 до 926 в день | Совокупные факты статьи |

Где исчезает выгода и страдает релиз

Локальные ускорения не складываются в общий результат. Выигрыш на генерации превращается в правки и повторные ревью.

Это бьёт по time‑to‑market. Релизы сдвигаются из‑за доработок и конфликтов интеграции. Качество нестабильно: больше откатов, больше проверок.

Экономика меняется: расходы растут быстрее, чем полезный выход. Основная ошибка — считать инструменты самоцелью, а не частью операционной модели. Без правил, метрик и ответственности ассистенты создают издержки вместо эффекта.

Что делать, чтобы получить результат

Компании ждут линейного роста от ИИ, но получают шум, правки и рост расходов. Факты это подтверждают: после доработок остаётся 10–30% принятого AI‑кода, churn растёт кратно, а «ускорение» часто требует кратно больше токенов.

Что делать: — Ввести единые правила использования и качества кода. — Считать метрики «стоимость → результат» (токены, churn, доля принятых изменений, время ревью). — Построить пайплайны с автоматической валидацией интеграцией. — Дать единый доступ корпоративным данным через общий AI‑слой.

Почему это работает: уменьшаются лишние итерации, падает доля правок, расходы привязываются к измеримому результату.

Итог: масштабируйте не инструменты, а «операционную систему ИИ». Иначе парадокс продуктивности при внедрении ИИ в бизнесе и разработке останется платной иллюзией.